Le monde de l'IA est en constante évolution avec l'émergence de nouveaux modèles comme DeepSeek-R1, Deepseek-V3, Kimi K-1.5 et Qwen-2.5-max. Ces avancées démocratisent le développement de l'IA et permettent aux innovateurs et développeurs du monde entier d'avoir accès aux technologies de pointe sans le coût prohibitif qui est généralement associé à de telles percées. Toutefois, le nombre croissant de modèles disponibles soulève souvent des questions cruciales : quel est le modèle le plus adapté à une application particulière ? Comment peut-on évaluer l'impact du passage à un modèle plus récent, plus performant et plus économique ?

Pour gérer ces préoccupations, il est essentiel d'avoir des outils de monitoring qui fournissent des informations détaillées et exploitables sur les performances, la qualité et le coût des applications d'IA. Ainsi, les développeurs peuvent adopter un modèle d'IA ou faire la transition entre différents modèles en toute confiance et en réduisant aussi les risques .

Introduction au monitoring DeepSeek avec New Relic AI Monitoring

Nous sommes très heureux d'annoncer que New Relic étend maintenant sa prise en charge du monitoring de l'IA aux modèles DeepSeek, qui viennent s'ajouter à notre couverture existante d'OpenAI, Claude, et AWS Bedrock. Cette intégration permet aux développeurs de pleinement tirer parti des capacités open source économiques de DeepSeek tout en maintenant une visibilité complète sur les performances des applications.

Les modèles DeepSeek ont retenu considérablement l'attention en raison de leurs architecture et efficacité novatrices. Par exemple :

- Le modèle DeepSeek-R1 dépasse bon nombre des autres principaux modèles d'IA en termes de raisonnement sur les tâches et sa structure tarifaire demeure nettement plus basse.

- Son architecture MoE (de l'anglais Mixture of Experts, ou mélange d'experts) active uniquement les sous-modèles pertinents pour des tâches spécifiques, réduisant ainsi les frais de calcul sans compromettre les performances.

Avec le monitoring de l'IA de New Relic, vous pouvez :

- Monitorer les applications développées sur les modèles DeepSeek en temps réel.

- Évaluer les métriques clés telles que les performances, la qualité et les coûts.

- Obtenir des informations détaillées sur l'impact des modèles sur la fonctionnalité globale de votre application.

Pourquoi choisir les modèles DeepSeek ?

Dans le monde de l'IA, DeepSeek s'est imposé comme un acteur incontournable en proposant des modèles haute performance pour une fraction du coût requis par ses plus grands concurrents tels qu'OpenAI ou Google. Les fonctionnalités clés comprennent :

- L'apprentissage par renforcement (Reinforcement learning) : DeepSeek emploie des techniques avancées d'apprentissage par renforcement pour les tâches de raisonnement.

- L'efficacité des coûts : les modèles tels que DeepSeek-R1 utilisent moins de ressources pendant l'apprentissage et l'inférence tout en assurant des performances de pointe.

- L'accessibilité open source : contrairement à de nombreux modèles exclusifs, la nature open source de DeepSeek permet aux développeurs de personnaliser et d'effectuer le déploiement localement et sans restrictions.

Ces attributs font de DeepSeek un choix très attractif pour les entreprises qui recherchent des solutions d'IA évolutives sans frais exorbitants.

Paramétrage et monitoring des modèles DeepSeek localement avec New Relic

Dans ce billet de blog, nous vous aiderons à paramétrer localement un modèle DeepSeek et à l'intégrer à New Relic AI Monitoring pour le monitoring efficace des performances.

Étape 1 : Déploiement d'un modèle DeepSeek localement

- Étant donné que DeepSeek a sorti son modèle localement, vous pouvez l'héberger vous-même, soit sur une machine personnelle, soit sur un environnement partagé.

- Une méthode simple d'exécuter les modèles DeepSeek consiste à utiliser Ollama, un outil qui permet de facilement exécuter toute catégorie de grands modèles de langage.

- Tout d'abord, installez Ollama en utilisant l'installateur que vous trouverez ici.

- Ensuite, téléchargez l'un des modèles DeepSeek.

- Si vous souhaitez simplement tester DeepSeek, le modèle distillé Llama doté de 8 milliards de paramètres devrait trouver le bon équilibre entre performances et demandes de ressources. Exécutez ollama pull deepseek-r1:8b

- Sur une machine moins puissante, ou si vous souhaitez économiser de l'espace disque, essayez le plus petit modèle, Qwen, avec 1,5 milliard de paramètres : ollama pull deepseek-r1:1.5b

- Enfin, exécutez votre modèle avec ollama run deepseek-r1:8b (ou substituez le modèle Qwen si vous l'avez téléchargé). Par défaut, cela lancera un serveur chat compatible avec OpenAI :

http://localhost:11434/v1/chat/completions. - DeepSeek recommande le SDK OpenAI pour interagir avec son modèle. Pour configurer votre client, suivez ces instructions.

Étape 2 : Intégration avec New Relic AI Monitoring

DeepSeek utilise une API compatible OpenAI et suggère l'utilisation du SDK OpenAI dans votre application. Nous effectuons donc le monitoring de l'application exactement comme nous le faisons avec une application utilisant OpenAI directement.

Une fois que votre application est déployée :

- Inscrivez-vous pour obtenir un compte New Relic gratuit ou connectez-vous si vous en avez déjà un.

- Cliquez sur Integrations & Agents.

- Dans la barre de recherche, tapez OpenAI et sélectionnez cette option.

- Choisissez le langage de programmation de votre application (Python, Node.js).

- Suivez le processus d'onboarding fourni par New Relic. Ce processus vous accompagne dans l'instrumentation de votre application d'IA développée avec DeepSeek. Nous avons nommé notre exemple d'application « deepseek-local ».

Étape 3 : Évaluation des performances, de la qualité et des coûts

Lorsque votre application est instrumentée, vous pouvez commencer à utiliser le monitoring de l'IA :

- Accédez à AI Monitoring : naviguez jusqu'à All Capabilities sur le dashboard New Relic et cliquez sur AI Monitoring.

Capacité AI Monitoring sous « All Capabilities »

- Sélectionnez l'exemple d'application : dans la section AI Monitoring, sous All Entities, sélectionnez l'exemple d'application deepseek-local développé en utilisant DeepSeek et Ollama.

Exemple d'application Deepseek-local affiché sous l'onglet AI Entities

- Visualisez la synthèse d'APM 360 : une fois la page chargée, vous verrez la synthèse d'APM 360. Cette vue unifiée vous donne des informations détaillées sur les métriques clés, telles que le nombre de requêtes, le temps de réponse moyen, l'usage de jetons et les taux de réponse aux erreurs ainsi que les signaux dorés de l'APM, les détails sur l'infrastructure et les logs. Vous pouvez rapidement identifier la source des problèmes et approfondir l'analyse.

Vue intégrée d'APM 360 et d'AI Monitoring

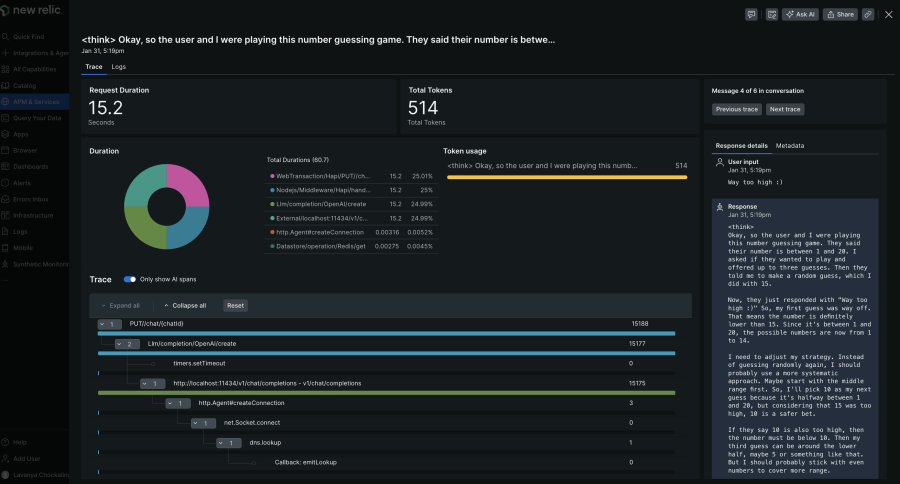

- Vue du tracing approfondi : pour une analyse plus détaillée associée à votre utilisation de DeepSeek, cliquez sur AI responses dans la synthèse d'APM 360 pour voir tout le parcours de la saisie de l'utilisateur à la réponse finale, comprenant les métadonnées tel le décompte des jetons, les informations sur le modèle et les interactions utilisateur. Ceci aide à rapidement identifier les causes profondes des problèmes.

La vue du tracing AI Responses qui fournit une visibilité de bout en bout de la demande et de la réponse

- Évaluation de la qualité des modèles : analyse les réponses LLM pour identifier et prévenir les problèmes tels que la toxicité, les insultes et la négativité. Cette capacité est actuellement disponible en avant-première limitée.

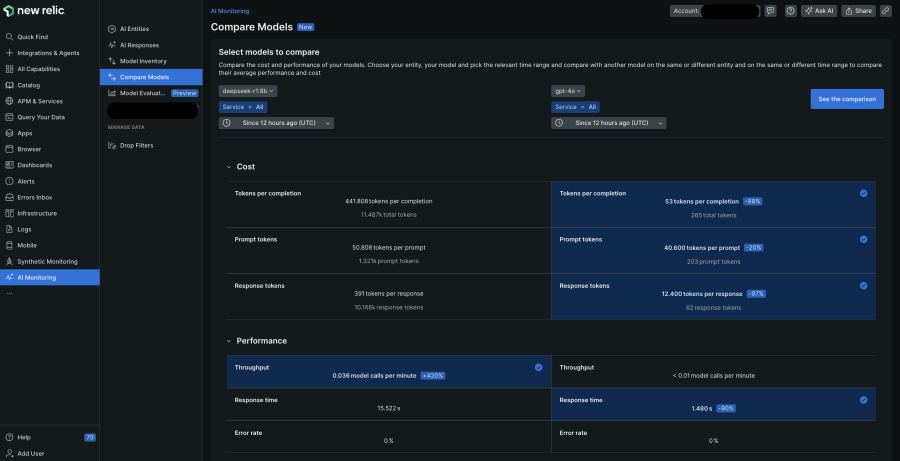

Étape 4 : Comparaison des modèles pour choisir ceux qui conviennent

La comparaison des modèles est un élément clé du monitoring de l'IA. Elle vous permet de comparer simplement les modèles DeepSeek à d'autres modèles que vous avez utilisés et d'évaluer les performances et les coûts, ce qui vous permet de faire le bon choix en fonction de vos besoins.

La vue de comparaison des modèles d'IA unique à AI Monitoring comparant les performances et coûts de deux modèles d'IA

Étape 5 : Sécurité et confidentialité des données

Pour compléter l'avantage de la sécurité des modèles hébergés localement, New Relic vous permet d'exclure le monitoring des données sensibles (tels que les renseignements personnels ou PII) dans vos requêtes et réponses d'IA : Cliquez sur Drop Filters, puis créez des filtres pour cibler certains types de données spécifiques au sein des six événements offerts.

Conclusion

L'émergence de modèles d'IA innovants comme DeepSeek-R1 marque un moment charnière dans la démocratisation de l'intelligence artificielle. Avec des outils comme New Relic AI monitoring fournissant la prise en charge complète du monitoring, les développeurs peuvent explorer en toute confiance ces nouveaux horizons tout en s'assurant que les performances des applications restent optimales.

Étapes suivantes

Alors que nous continuons à étendre la prise en charge des technologies d'IA de pointe, inscrivez-vous à New Relic AI Monitoring et gardez une longueur d'avance dans ce domaine en constante évolution.

Les opinions exprimées sur ce blog sont celles de l'auteur et ne reflètent pas nécessairement celles de New Relic. Toutes les solutions proposées par l'auteur sont spécifiques à l'environnement et ne font pas partie des solutions commerciales ou du support proposés par New Relic. Veuillez nous rejoindre exclusivement sur l'Explorers Hub (discuss.newrelic.com) pour toute question et assistance concernant cet article de blog. Ce blog peut contenir des liens vers du contenu de sites tiers. En fournissant de tels liens, New Relic n'adopte, ne garantit, n'approuve ou n'approuve pas les informations, vues ou produits disponibles sur ces sites.